|

Методические указания к выполнению лабораторных работ Самостоятельная работа студентов |

| << Предыдущая | Оглавление | Следующая >> |

Тема №1:

Информация, Информатика, Представление информации

1. Понятие об информации. Предмет информатики

Строго научного определения, что такое информация не существует. Разные люди при разных обстоятельствах могут вкладывать в это понятие разный смысл. В бытовом смысле информация – это сведения, которые человек получает от окружающего мира с помощью органов чувств. Для математика понятие информации шире. Информация – это те сведения, которые человек создал сам с помощью умозаключений. (Теоремы, Постулаты, Аксиомы). Для биолога к информации относятся и те данные, которые человек хранит в себе с момента рождения и до самой смерти. Это генетический код, благодаря которому дети так похожи на своих родителей.

Итак, в разных научных дисциплинах и в разных областях техники существуют разные понятия об информации. Но все отрасли сходятся в том, что информацию необходимо создавать, передавать, принимать, хранить и обрабатывать. Вот это и есть задачи информатики.

Информатика – это техническая наука, изучающая способы создания, хранения, обработки и передачи (и защиты) информации средствами вычислительной техники.

Возникнув как наука об информации, информатика в настоящее время развивается по многим другим направлениям. Предмет информатики точно невозможно определить – он сложный, многосторонний, динамичный.

Предметная область информатики |

||

Теоретическая информатика (Brainware) Этот раздел информатики использует математические методы для общего изучения процессов обработки информации. |

Прикладная информатика изучением закономерностей в информационных процессах (накопление, переработка, распространение); |

Технические средства (Hardware) раздел, в котором разрабатываются общие принципы построения вычислительных систем. Речь идет не о технических деталях и электронных схемах (это лежит за пределами информатики как таковой), а о принципиальных решениях на уровне, так называемой, архитектуры вычислительных (компьютерных) систем, определяющей состав, назначение, функциональные возможности и принципы взаимодействия устройств. |

2. Свойства информации

2.1. Качественные характеристики информации

Основные свойства информации:

Достаточность (Полнота) - характеризует качество информации и определяет минимальный, но достаточный набор данных для принятия решений или для создания новых данных, на основе имеющихся

Пример: Вы прочитали в газете такое сообщение: "Будет дождь". Это неполная информация, т. к. не сказано, когда именно будет дождь. "Завтра после полудня будет дождь" - полная информация

Актуальность - это степень соответствия информации текущему моменту времени.

"На прошлой неделе в это время в Ярославле шёл дождь" - эта информация для нас не актуальна, т. к. она является устаревшей. "Завтра в Лондоне будет дождь" - это может быть новая, достоверная и полная информация, но для нас она не актуальна, т.к. мы не поедем в Лондон и нам не интересно, какая там погода. "Скоро улицы нашего города будут затоплены" - такая информация является для нас актуальной.

Адекватность – это степень соответствия создаваемого с помощью полученной информации образа реальному объекту, процессу, явлению и т.п.

Доступность – это мера возможности получить ту или иную информацию.

Понятность

Достоверность

Массовость

Устойчивость

Ценность

2.2. Количественные характеристики информации

| Меры информации | ||

Синтаксическая мера |

Семантическая мера |

Прагматическая мера |

оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту. (На синтаксическом уровне учитываются тип носителя и способ представления информации, скорость передачи и обработки, размеры кодов представления информации)

|

измерения смыслового содержания информации. Для измерения смыслового содержания информации, т.е. ее количества на семантическом уровне, наибольшее признание получила тезаурусная мера, которая связывает семантические свойства информации со способностью пользователя принимать поступившее сообщение. Для этого используется понятие тезаурус пользователя. Тезаурус — это совокупность сведений, которыми располагает пользователь или система. |

определяет полезность информации (ценность) для достижения пользователем поставленной цепи |

Кол-во информации (Формула Шеннона)

Количество информации определяется так же через понятие энтропии системы. Энтропия Больцмана – это мера беспорядка. При равновероятном распределении параметров системы (например, направлений движения молекул) энтропия максимальна! При упорядочивании системы (задание определенного направления движения) энтропия уменьшается.

Текст с максимальной энтропией – равновероятное распределение букв – бессмысленное содержание – 0 информации. Теперь пусть в неком информационном сообщении (в SMS-сообщении) случайным образом из-за помех некоторые буквы были заменены. Информация – это нужные, верные, достоверные сигналы - I. Неверные буквы - это шум, беспорядок - H.

H + I = 1

Пусть Pi это вероятность того, что система находится в состоянии i. (вероятность того, что буква будет, например «В»). Кол-во возможных состояний N. Тогда энтропия по Шеннону – это мера недостающей информации:

![]()

Энтропия Шеннона количественно характеризует достоверность передаваемых сигналов.

3. Технологии работы с информацией. Кодирование информации

3.1 Получение, передача и хранение информации. Кодирование

Первым носителем человеческих знаний и опыта, первым средством обмена информации между людьми стала человеческая речь. Но, несмотря на все богатство возможностей передачи информации, предоставляемых языками, описать с их помощью можно далеко не все. Поэтому для передачи и сохранения информации стали использоваться рисунки, чертежи, схемы, а впоследствии — фотографии, телевизионные изображения и т. д. В настоящее время применяют множество специальных языков, приспособленных для передачи информации конкретного содержания, появляющейся при решении определенных задач. К ним можно отнести языки математики, физики, химии и других научных дисциплин, дорожные знаки, обозначения на картах и многие, многие другие. Количество таких языков непрерывно увеличивается в прямой зависимости от роста многообразия решаемых человеком задач.

!!! Любая информация всегда хранится в виде кодов !!! |

Кодирование – это представление сведений в том или ином стандартном виде.

Какой же язык, какой способ кодирования применить в информатике? Ответ на этот вопрос нашел Клод Элвуд Шеннон (ClaudeElwoodShannon, 1916-2001) – американский математик и электротехник. В своей диссертации, защищенной в 1940 году, он доказал, что работу переключателей и реле в электрических схемах можно представить посредством алгебры, изобретенной в середине XIX века английским математиком Джорджем Булем. "Просто случилось так, что никто другой не был знаком с этими обеими областями одновременно!" - так скромно Шеннон объяснил причину своего открытия

Булева алгебра – основа работы компьютера

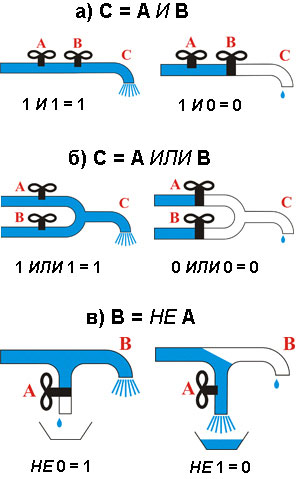

Булева алгебра рассматривает величины, принимающие только два значения – 0 или 1. Значение булевой величины можно представлять как ложность или истинность какого-либо утверждения (0 – ложь, 1 – истина). Поэтому с такими величинами можно производить различные логические операции. Основные операции – это и, или, не.

Вы пойдете в кино, если у вас будут деньги и свободное время.

У вас будут деньги, если вы их заработаете или вам их дадут родители. (Вариант ограбления банка не рассматриваем).

У вас будет свободное время, если вам не надо готовиться к экзамену.

Выполнение логических операций можно проиллюстрировать на наглядной физической модели «водопровода». (рис.1.1.) Представим утверждения, над которыми производятся операции, в виде вентилей на трубах (открытый вентиль – утверждение истинно, закрытый – ложно). Результат операции представим в виде крана, из которого вода может либо течь (истина), либо не течь (ложь).

Выполнением подобных операций и занимается процессор компьютера. Оказывается, именно триод и транзистор выполняют функции вентиля в электрической схеме. (Если хотите понять как см. физические принципы работы триода и транзистора).

3.3 Двоичная система исчисления. Бит. Байт.

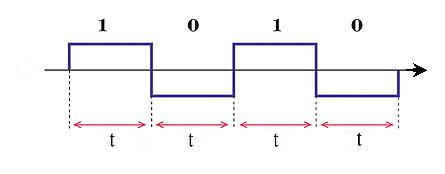

Итак, в вычислительной технике применяется двоичная система счисления. Вся информация представляется в виде определенной последовательности нулей и единиц (0 – нет сигнала, 1 – есть сигнал): 010001110011001110111.

Т.е. наименьшая единица информации принимает значение либо 0, либо 1.

Т.е. наименьшая единица информации принимает значение либо 0, либо 1.

| Наименьшая единица информации называется – бит. |

Разумеется, с помощью одного бита невозможно представить цифры десятичной системы исчисления или буквы алфавита, поэтому для представления символов используется несколько бит.

8 бит это 1 байт.

Одного байта уже достаточно для представления основных чисел и букв. В байт можно записать 256 различных комбинаций нулей и единиц - это позволяет закодировать 256 разных символов. Коды символов задаются здесь с помощью кодировочной таблицы – кодировки (для каждого кода указывается соответствующий символ).

Одна из самых старых компьютерных кодировок American Standard Code for Information Interchange – ASCII (аски). В ней первые 128 приходятся на символы латинского алфавита, а последующие - на умляуты и символы для создания псевдографических изображений. Например символу "A" соответствует число 65. Именно символы, занимающие позиции 128-255, в эпоху MSDOS заменялись на символы кириллицы. Так возникли вариации стандартной кодировки ASCII, получившие названия KOI8-R.

В настоящее время проблема множества несовместимых кодировок практически решена путем использования двухбайтовой кодировки. При такой кодировке можно закодировать 65 535 символов. Постепенно происходит переход к стандартной двухбайтовой кодировке UTF-8 (Unicode), в которую изначально включены все символы не только латиницы и кириллицы, но и множества других алфавитов (в настоящее время занято 29000 возможных комбинаций).

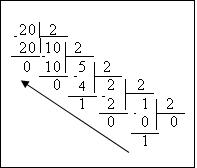

Как перевести десятичное число в двоичное?

Делением на два, остаток, записанный с конца, и есть двоичное число.

20 = 10100

Как перевести двоичное число в десятичное?

Надо сложить двойки в степенях, соответствующих позициям, где в двоичном стоят единицы.

Например: Возьмем число 20. В двоичной системе оно имеет следующий вид: 10100. Итак (начнем слева направо, считая от 4 до 0; число в нулевой степени всегда равно единице (вспоминаем школьную программу по математике)):

10100 = 1*24 + 0*23 + 1*22 + 0*21 + 0*20 = 20

16+0+4+0+0 = 20

Так как в двоичной системе счисления основанием является число 2, то все единицы информации кратны двум в степени n (2n):

1 б = 8 бит = 23 бит

1 Кб = 210 б = 1024 б

1 Мб = 220 б = 1024 Кб

1 Гб = 230 б = 1024 Мб

1 Тб = 240 б = 1024 Гб

Реклама: «При покупке у нас 1 Mб памяти 24 Кб вы получаете бесплатно»

Важно иметь представление, сколько информации может вместить килобайт, мегабайт или гигабайт. При двоичном кодировании текста каждая буква, знак препинания, пробел занимают 1 байт. На странице книги среднего формата примерно 50 строк, в каждой строке около 60 символов, таким образом, полностью заполненная страница имеет объём 50 x 60 = 3000 байт 3 Килобайта. Вся книга среднего формата занимает ? 0,5 Мегабайт. Один номер четырёхстраничной газеты — 150 Килобайт. Если человек говорит по 8 часов в день без перерыва, то за 70 лет он наговорит около 10 Гигабайт информации. Один чёрно-белый кадр (при 32 градациях яркости каждой точки) содержит примерно 300 Кб информации, цветной кадр содержит уже около 1 Мб информации. Телевизионный фильм продолжительностью 1,5 часа с частотой 25 кадров в секунду — 135 Гб.

3.4. Кодирование текста

Текст закодировать довольно просто. Для этого достаточно как-нибудь перенумеровать все буквы, цифры, знаки препинания и другие используемые при письме символы. Для хранения одного символа чаще всего используется восьмиразрядная ячейка — один байт, иногда два байта (иероглифы, например). В байт можно записать 256 различных чисел, значит, это позволит закодировать 256 различных символов. Соответствие символов и их кодов задаётся в специальной таблице. Коды записываются в шестнадцатеричной системе, так как для записи числа из восьми разрядов нужно всего две шестнадцатеричных цифры.

3.5. Кодирование звука

3.6. Кодирование изображения

Цветные изображения воспринимаются нами как сумма трёх основных цветов — красного, зелёного и синего.

Например: сиреневый = красный + синий; жёлтый = красный + зелёный; оранжевый = красный + зелёный, но в другой пропорции.

Поэтому достаточно закодировать цвет тремя числами — яркостью его красной, зелёной и синей составляющих. Этот способ кодирования называется RGB (Red—Green—Blue). Его используют в устройствах, способных излучать свет (мониторы).

При рисовании на бумаге действуют другие правила, так как краски сами по себе не испускают свет, а только поглощают некоторые цвета спектра. Если смешать красную и зелёную краски, то получится коричневый, а не жёлтый цвет. Поэтому при печати цветных изображений используют метод CMY (Cyan—Magenta—Yellow) — голубой, сиреневый, жёлтый цвета. При таком кодировании красный = сиреневый + жёлтый; зелёный = голубой + жёлтый.

Вопросы по теме лекции

| << Предыдущая | Оглавление | Следующая >> |